iPhone内の画像から勝手に児童ポルノを通報するAIに「欠陥」がみつかるName名無し21/08/26(木)02:06:15 IP:106.180.*(au-net.ne.jp)No.213059そうだねx1

22年6月頃消えます https://nazology.net/archives/95176

Apple社の児童ポルノ検出技術に欠陥が発見されました。

現在Appleは、アメリカにおいて、個人の持つiPhoneやiCloudを勝手にスキャンして、児童ポルノを通報する「NeuralHash」というAIソフトの導入を進めています。

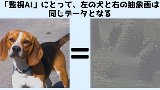

しかし8月18日にコード共有ウェブサイトGitHubのユーザーがシェアした情報によると、肝心のAIソフト(NeuralHash)が「犬と抽象画」を同じ画像と認識していると発見したとのこと。

iPhoneは膨大な数が世に出回っているため、わずかな誤検出率でも、誤認逮捕を引き起こす可能性があります。

しかし、いったいどうしてNeuralHashは犬の写真と抽象画を「同一」と判断してしまったのでしょうか?

| …No.213060+AIで無断で監視ってのがデマじゃないとしたら よく訴訟問題にならんよね ペドを言い訳にすると、あっちでも検閲は許されるのか? |

| …No.213061+全裸 毛むくじゃら 四つん這い 物欲しそうな顔 センサー合ってる気がする |

| …No.213062+ペールチェック 削除.. |

| …No.213065+愛娘の画像をiPhoneやiCloudにぶち込んでるお父ちゃん戦々恐々 |

| …No.213069そうだねx1>ペドを言い訳にすると、あっちでも検閲は許されるのか? ペドに限らず人権問題にはそんな感じ。 |